Ich war natürlich auf der Gamescom 2024, dabei gehe ich tatsächlich für das Event als solches, Merchandise Produkte und das Kennenlernen neuer Spiele dorthin. Dieses Jahr empfand ich es zum ersten Mal als recht langweilig.

Gamescom 2024 weiterlesenBlog

Warum KI-Projekte scheitern und wie sie erfolgreich umgesetzt werden können

Die sprunghafte Entwicklung und Implementierung von Künstlicher Intelligenz (KI) hat in vielen Bereichen große Hoffnungen geweckt. Unternehmen und staatliche Organisationen weltweit investieren massiv in KI-Technologien, um ihre Effizienz zu steigern, innovative Produkte zu entwickeln und komplexe Probleme zu lösen.

Doch trotz dieser Begeisterung zeigt eine kürzlich veröffentlichte Studie der RAND Corporation, dass ein Großteil der KI-Projekte scheitert.

Warum KI-Projekte scheitern und wie sie erfolgreich umgesetzt werden können weiterlesen„The Prompt Report“: Leitfaden für effektives Prompting

In der Welt der generativen Modelle hat sich das Konzept des „Prompting“ als essenziell herausgestellt. Die Fähigkeit, die richtigen Eingaben (Prompts) zu formulieren, entscheidet oft über die Qualität und Nützlichkeit der generierten Antworten von Modellen wie GPT-4.

Der „Prompt Report“ bietet eine systematische Analyse und stellt Techniken und Vokabular bereit, um das Prompting zu meistern. Dieser Blog-Beitrag fasst die wichtigsten Erkenntnisse dieser Studie zusammen und gibt eine praktische Anleitung für den alltäglichen Einsatz.

„The Prompt Report“: Leitfaden für effektives Prompting weiterlesenWhitepaper des BSI zur Transparenz von KI-Systemen

Nun, da Künstliche Intelligenz (KI) zunehmend in verschiedenen Bereichen Einzug hält, ist die Transparenz dieser Systeme von zentraler Bedeutung – auch in juristischer Hinsicht mit Blick auf die EU-KI-Verordnung. Das Bundesamt für Sicherheit in der Informationstechnik (BSI) hat ein umfassendes Whitepaper veröffentlicht, das die Wichtigkeit und die Anforderungen an die Transparenz von KI-Systemen beleuchtet. Ich gehe kurz auf die Kernaussagen dieses Whitepapers vor und erläutern, warum Transparenz für die Akzeptanz und das Vertrauen in KI-Systeme essenziell ist.

Whitepaper des BSI zur Transparenz von KI-Systemen weiterlesenVorsicht bei Studien zu großen Sprachmodellen (LLMs)

Eine frühere Studie mit dem Titel „Physics of Language Models: Part 2.1, Grade-School Math and the Hidden Reasoning Process“, stellte die Leistungsfähigkeit von Transformer-Modellen bei der Lösung elementarer mathematischer Textaufgaben in den Mittelpunkt. Diese Arbeit behauptet, tiefgreifende Einsichten in die Fähigkeiten von großen Sprachmodellen (LLMs) zu liefern.

Jedoch zeigt eine kritische Analyse von Ernest Davis von der New York University, dass diese Studie ein hervorragendes Beispiel dafür ist, wie vorsichtig man bei der Bewertung und Interpretation von Forschungsergebnissen im Bereich der LLMs sein muss.

Vorsicht bei Studien zu großen Sprachmodellen (LLMs) weiterlesenModel Autophagy Disorder: Generative Modelle in der Selbstzerstörung?

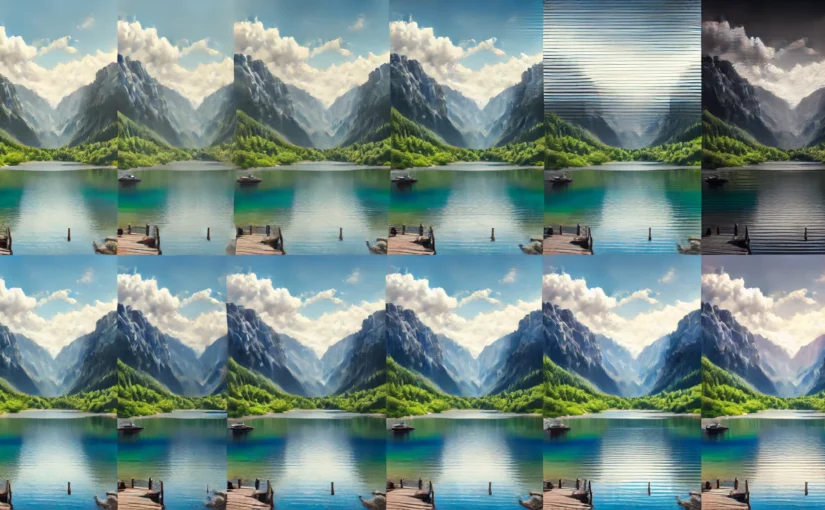

In der modernen Welt der Künstlichen Intelligenz (KI) haben generative Modelle eine Revolution ausgelöst. Diese Modelle erzeugen Bilder, Texte und andere Datentypen, die zunehmend von Unternehmen und in Konsumentendiensten eingesetzt werden. Doch was passiert, wenn diese Modelle beginnen, sich selbst zu konsumieren? Die kürzlich durchgeführte Studie, „Self-Consuming Generative Models Go MAD“, beleuchtet diese Frage und liefert besorgniserregende Einblicke.

Model Autophagy Disorder: Generative Modelle in der Selbstzerstörung? weiterlesenVertragliche Auswirkungen behördlicher Warnung vor Virenschutzsoftware

Das BSI warnte vor dem Einsatz von Kaspersky-Virenschutz-Software – doch welche vertraglichen Auswirkungen hat diese Warnung auf laufende Verträge? Eine Antwort liegt nun bei

Das Landgericht München I hat am 13. Dezember 2023 im Urteil (Az. 29 O 1152/23) zentrale Fragen zur mietvertraglichen Überlassung von Software, zur Definition von Mängeln bei Software, zur Auswirkung von öffentlich-rechtlichen Sanktionen auf die Nutzung von Software und zum Wegfall der Geschäftsgrundlage behandelt. Das Urteil bietet eine erstmalige umfassende rechtliche Analyse und Argumentation zu diesen komplexen Themen.

Vertragliche Auswirkungen behördlicher Warnung vor Virenschutzsoftware weiterlesenKI-Lösungen am Scheideweg

Zweifel an der Wirtschaftlichkeit von KI: In jüngster Zeit haben kritische Stimmen die Wirtschaftlichkeit der KI-Branche infrage gestellt.

Ein bemerkenswerter Beitrag hierzu kam vom Hedgefonds Elliott, der in einem Brief an seine Kunden den Hype um künstliche Intelligenz als „überbewertet“ bezeichnete. Elliott argumentiert, dass viele KI-Anwendungen unausgereift seien und möglicherweise nie kosteneffizient funktionieren würden. Dies habe auch Auswirkungen auf den Aktienkurs von Nvidia und anderen großen Tech-Unternehmen, die stark in KI investieren.

KI-Lösungen am Scheideweg weiterlesenAngriffsszenarien auf LLM durch Formulierung in Vergangenheitsform

In einer kürzlich durchgeführten Studie haben Forscher der EPFL (Eidgenössische Technische Hochschule Lausanne) eine interessante Schwachstelle in den aktuellen Ablehnungsmechanismen von großen Sprachmodellen (Large Language Models, LLMs) aufgedeckt.

Diese Schwachstelle ermöglicht es, die Sicherheitsvorkehrungen vieler LLMs zu umgehen, indem man gefährliche Anfragen einfach in die Vergangenheitsform umformuliert. Dieser Blog-Beitrag beleuchtet die Ergebnisse der Studie und deren Implikationen für die Zukunft der LLM-Sicherheit.

Angriffsszenarien auf LLM durch Formulierung in Vergangenheitsform weiterlesenBGH: KI kann kein Erfinder sein

Der Bundesgerichtshof (BGH) hat in einem jüngsten Beschluss vom 11. Juni 2024 entschieden, dass Künstliche Intelligenz (KI) nicht als Erfinder im Sinne des Patentrechts anerkannt werden kann (Az.: X ZB 5/22). Diese Entscheidung hat weitreichende Konsequenzen für die Patentlandschaft und die rechtliche Behandlung von Erfindungen, die durch KI-generierte Prozesse entstehen.

BGH: KI kann kein Erfinder sein weiterlesen